La discusión sobre inteligencia artificial ya no puede reducirse a innovación, desarrollo o competitividad. El eje se ha desplazado hacia una pregunta más incómoda y decisiva: quién decide, con qué legitimidad y hasta dónde una sociedad está dispuesta a delegar el juicio humano en sistemas automatizados.

Ese fue uno de los núcleos del X Coloquio Internacional sobre IA, Bioética y Neuroética, realizado en la Pontificia Universidad Católica de Rio Grande do Sul, en Brasil. El encuentro dejó una conclusión difícil de eludir: la IA dejó de ser una herramienta neutral para convertirse en un problema de poder, responsabilidad y límites.

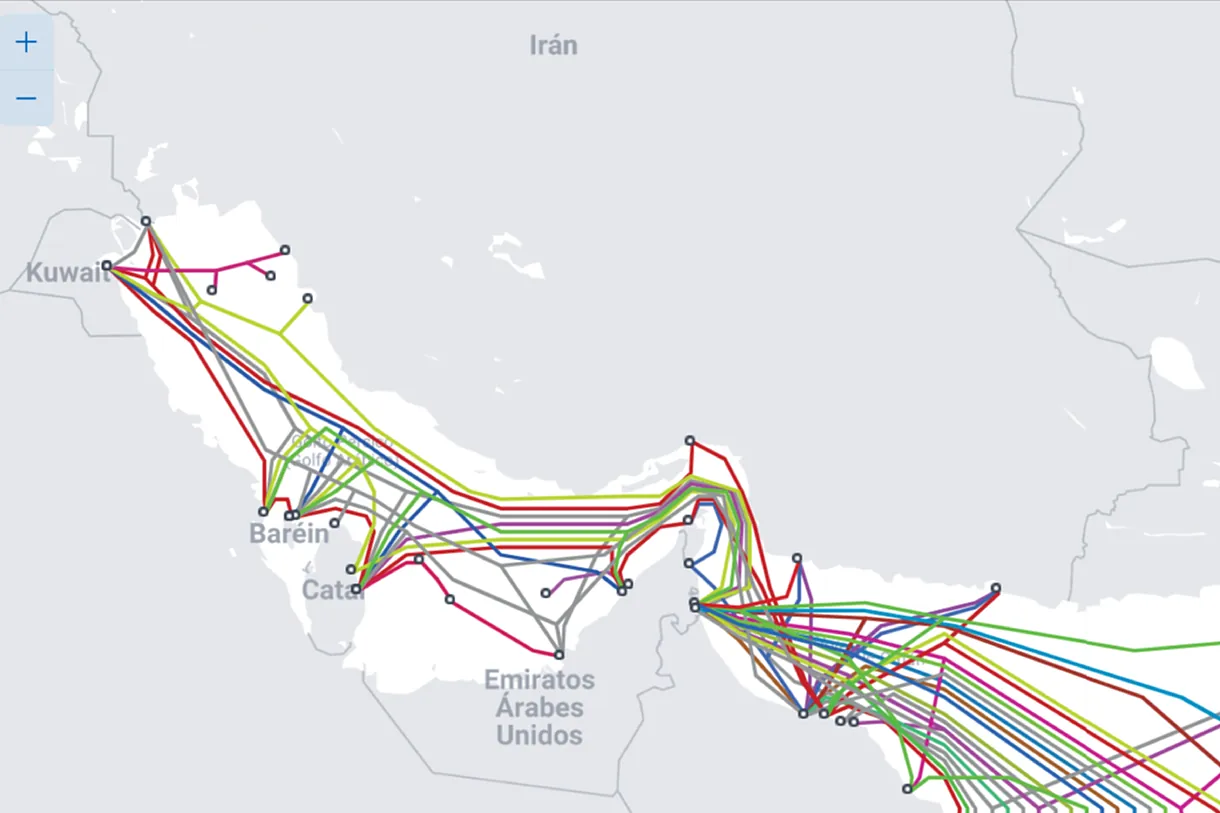

Con especialistas de América, Europa, Asia y Medio Oriente, el coloquio abordó temas como sostenibilidad, sesgos algorítmicos, medicina, protección de datos, gobernanza democrática y agencia artificial. La amplitud de la agenda refleja un cambio de época: cuando la tecnología interviene sobre derechos, instituciones y decisiones públicas, deja de ser un instrumento y pasa a ocupar el centro del debate político.

En ese contexto, una de las intervenciones más relevantes fue la del bioeticista argentino Fishel Szlajen, miembro de la Comisión Nacional de Bioética. Allí presentó su propuesta de la “Ética del Límite”, un marco conceptual que busca establecer fronteras claras para la gobernanza de la inteligencia artificial y las biotecnologías emergentes.

Su planteo introduce un giro clave en la discusión: no se trata solo de cómo regular la IA, sino de definir qué decisiones no deben delegarse nunca a un algoritmo, aun cuando la tecnología lo permita. Es un desplazamiento que cuestiona el enfoque dominante, centrado en la eficiencia, la transparencia o la mitigación de sesgos, pero que rara vez se pregunta si corresponde automatizar ciertas decisiones.

Como explicó Szlajen, incluso un sistema técnicamente impecable puede resultar normativamente inaceptable si invade ámbitos que exigen deliberación humana directa. El problema ya no es únicamente si el algoritmo funciona, sino si debe decidir.

La cuestión adquiere especial gravedad en áreas como salud, justicia, seguridad, educación y políticas públicas. Allí, la automatización no solo puede generar errores o sesgos, sino también diluir responsabilidades, erosionar la rendición de cuentas y reemplazar el juicio prudencial por criterios de rendimiento.

El riesgo, advierte el bioeticista, es que la lógica de la optimización termine desplazando la dimensión ética. Lo “mejor” deja de definirse por su justicia o legitimidad y pasa a medirse por su rapidez o eficiencia. En ese marco, se vuelve urgente distinguir entre superioridad técnica y validez normativa: lo más veloz no siempre es lo más justo, ni lo más rentable necesariamente lo más humano.

Uno de los aportes más significativos del coloquio fue precisamente abandonar cierta ingenuidad tecnocrática. Ya no alcanza con auditorías, protocolos o declaraciones de buenas prácticas. La discusión central es previa: establecer límites antes de que la tecnología desborde la capacidad regulatoria.

La “Ética del Límite” propone, en ese sentido, un enfoque preventivo. No se trata de corregir daños una vez producidos, sino de impedir que ocurran fijando fronteras claras. Sin ese criterio, la gobernanza queda reducida a respuestas tardías frente a sistemas que ya se han impuesto en la práctica.

El planteo adquiere especial relevancia en contextos como el argentino, donde el debate sobre IA oscila entre el entusiasmo superficial y la falta de marcos regulatorios sólidos. La propuesta introduce una pregunta que ordena la discusión: no solo qué puede hacer la inteligencia artificial, sino qué no debería hacer nunca.

En un tiempo donde modernización suele confundirse con automatización, la cuestión de fondo es otra. Quién conserva el juicio, quién asume la responsabilidad y quién fija los límites frente a una tecnología que avanza más rápido que las normas. El coloquio terminó, pero dejó planteado un desafío que apenas comienza: gobernar la inteligencia artificial antes de que ella condicione la forma de gobernar.